Quando o ativista político sul-coreano Kim Dae-jung ficou preso por dois anos no início da década de 1980, ele devorou cerca de 600 livros em sua cela. Uma obra que deixou impressão duradoura foi “A Terceira Onda”, do renomado futurista Alvin Toffler, que argumentava que uma iminente revolução da informação estava prestes a transformar o mundo de maneira tão profunda quanto as revoluções agrícola e industrial que a precederam.

Mais tarde, quando foi eleito presidente, Kim se referiu ao livro muitas vezes em seu esforço para transformar a Coreia do Sul em uma potência tecnológica.

Um novo e abrangente trabalho de futurismo surge 43 anos após a publicação do livro de Toffler, com tema e nome semelhantes.

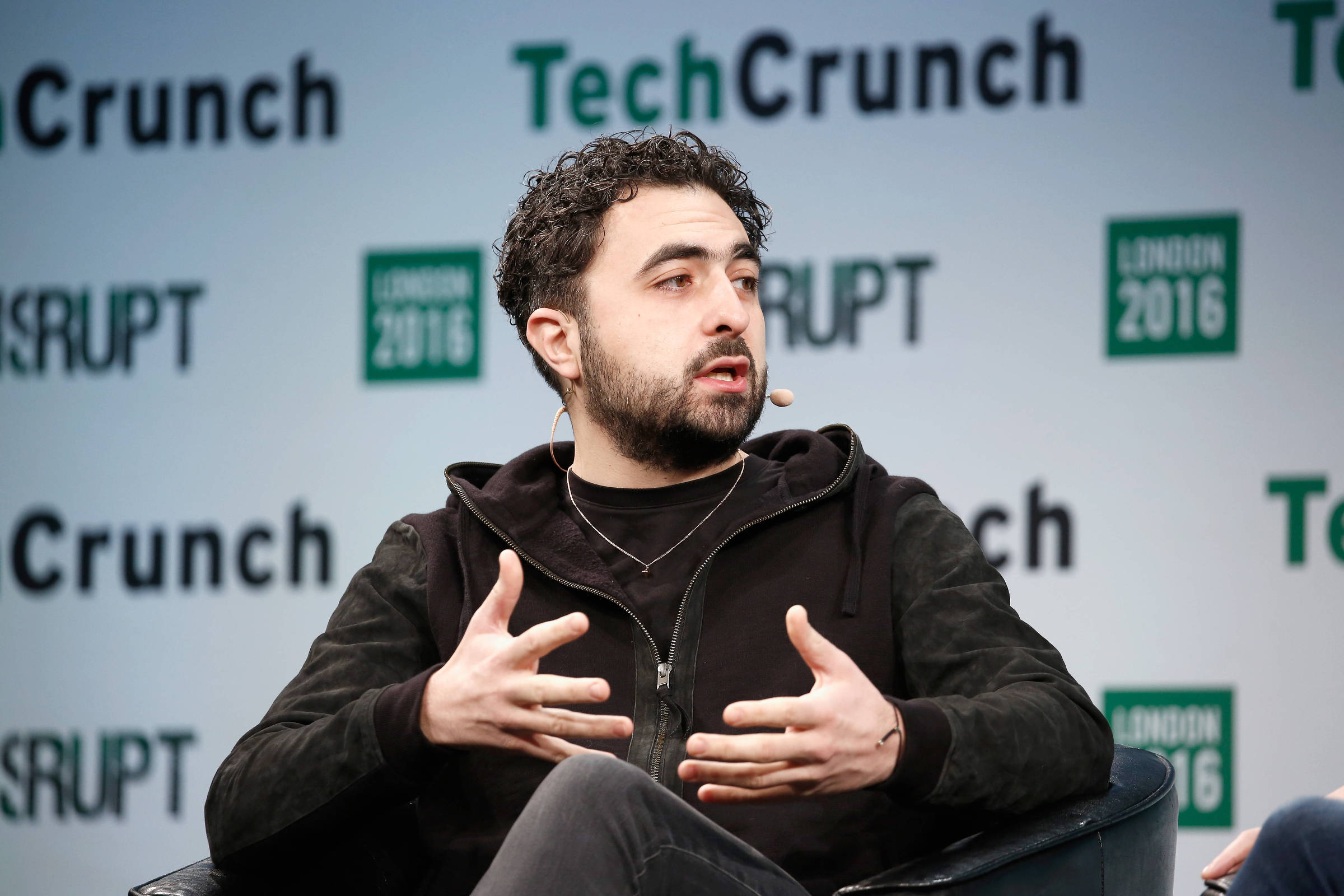

A principal diferença é que “The Coming Wave” [a nova onda], de Mustafa Suleyman, se concentra mais nas revoluções gêmeas da inteligência artificial e da biologia sintética. Mas o autor certamente ficaria muito feliz caso seu livro se mostrasse tão influente quanto o de Toffler, levando os políticos a agir.

Um dos três fundadores da DeepMind, empresa de pesquisa de inteligência artificial sediada em Londres, e atual presidente-executivo da startup Inflection, Suleyman está na vanguarda do setor há mais de uma década.

O livro “The Coming Wave” está repleto de empolgação palpitante sobre as extraordinárias possibilidades que as revoluções na inteligência artificial e na biologia sintética podem concretizar.

A inteligência artificial, nos dizem, pode desvendar os segredos do universo, curar doenças e ampliar os limites da imaginação. A biotecnologia pode nos permitir engendrar vida e transformar a agricultura. “Juntas, elas darão início a uma nova alvorada, criando riqueza e excedentes como jamais se viu”, ele escreve.

No entanto, o que chama a atenção no livro pesadamente divulgado de Suleyman é a maneira pela qual o otimismo de sua vontade é sobrepujado pelo pessimismo de seu intelecto, para usar uma frase do filósofo marxista Antonio Gramsci. Por boa parte da História, o desafio da tecnologia foi descobrir como liberar seu poder, escreve Suleyman. Agora o desafio se inverteu.

No século 21, o dilema será como conter o poder da tecnologia, agora que as capacidades das novas tecnologias explodiram e o custo para desenvolvê-las caiu. “Contenção não é possível, até onde se sabe. E, no entanto, para o bem de todos nós, a contenção precisa ser possível”, ele escreve.

A lista de preocupações de Suleyman é longa e elas em parte se interconectam. A inteligência artificial pode potencializar a desinformação e a guerra cibernética em escala industrial, direcionar enxames de drones assassinos contra alvos civis e resultar em grandes interrupções econômicas e na rotatividade de empregos.

A biologia sintética pode ser explorada para criar patógenos mortais de baixo custo. Em grande parte, os governos não foram capazes de entender essas ameaças tecnológicas, muito menos preparar suas sociedades para a escala da turbulência que pode vir.

Mas Suleyman admite que o setor de tecnologia também não prestou o devido cuidado e atenção aos danos colaterais causados por seus produtos, o que contribuiu para o aumento da desigualdade econômica e a erosão da confiança na democracia.

Levando em conta a onda tecnológica que está prestes a se abater sobre nós, o leitor comum pode concluir, como muitos tecnólogos em uma carta aberta divulgada recentemente, que devemos interromper o desenvolvimento de modelos avançados de inteligência artificial generativa até que estejamos mais bem preparados. “Absolutamente não”, rebate Suleyman. “Não se engane: um impasse seria um desastre”. Resolver a questão da mudança no clima, elevar os padrões de vida ou melhorar a educação aparentemente só acontecerão se as novas tecnologias fizerem parte do pacote, ele afirma.

Repleto de generalizações abrangentes e prognósticos extremos, partes do livro de Suleyman parecem uma versão reescrita pelo ChatGPT de “Homo Deus”, o livro de história do futuro de Yuval Noah Harari.

E, na verdade, a maioria das questões exploradas nas seções iniciais do livro já foi examinada em outros lugares com mais discernimento e em prosa menos extravagante. Se você quiser ter uma visão mais sutil dos desafios quanto ao controle da inteligência artificial, experimente “Human Compatible” (2019), de Stuart Russell. Sobre edição de genes, leia “A Crack in Creation” (2018), de Jennifer Doudna, ganhadora do Prêmio Nobel. E sobre as implicações geopolíticas da inteligência artificial, “The Age of AI” (2021), do veterano diplomata Henry Kissinger, é uma fonte mais confiável.

O livro de Suleyman é mais valioso em sua seção de conclusão, na qual ele descreve 10 etapas para uma possível contenção.

Algumas das recomendações de Suleyman são técnicas, sensatas e prontamente implementáveis. Hoje, menos de 1% dos mais de 30 mil pesquisadores de inteligência artificial do planeta trabalham com questões de segurança. As empresas de tecnologia e as universidades devem, de fato, investir mais nessa área, como Suleyman recomenda.

Também ajudaria se fossem feitos mais esforços para limpar os conjuntos de dados usados para treinar modelos de inteligência artificial quanto a vieses sociais inerentes, e se houvesse uma maior concentração na parte explicativa e na corrigibilidade (a capacidade de corrigir erros) desses modelos. Se possível, seria sensato criar “interruptores à prova de balas” em sistemas de biologia sintética, robótica e inteligência artificial.

O setor também se beneficiaria de auditores externos especializados. As empresas com fins lucrativos, que estão impulsionando a tecnologia, também poderiam adotar uma visão mais ampla de suas responsabilidades sociais se passassem por uma mudança de status, para o de “empresas de interesse global”, algo que, curiosamente, ele observa que a DeepMind já considerou.

Os governos poderiam desempenhar papel importante ao restringir o acesso aos chips de ponta que alimentam os modelos de inteligência artificial de última geração e ao proibir completamente os modelos de IA de código aberto, por medo de que sejam alvo de abusos por parte de agentes mal-intencionados.

Ao contrário de muitos tecnólogos sediados nos EUA, Suleyman recebe positivamente a futura Lei de Inteligência Artificial da União Europeia, por mais imperfeita que seja, porque ela tem o foco e a ambição certos em termos de classificação dos riscos para os usuários. Serão necessários tratados internacionais para redigir novas regras de guerra. A sociedade civil será fundamental para responsabilizar as empresas de tecnologia e moldar novas normas para a edição de genes.

Não falta atividade em algumas dessas áreas. O observatório de políticas da OCDE (Organização para a Cooperação e Desenvolvimento Econômico) registra nada menos que 800 diretrizes políticas de inteligência artificial em 60 países no seu banco de dados. Mas Suleyman tem razão ao enfatizar a importância da coordenação e da coerência. E isso gira em torno da ação humana e da complicada arte da política.

A maneira pela qual a IA transformará a política é o tema de “The Handover”, de David Runciman, professor de política na Universidade de Cambridge. O engenhoso argumento de Runciman é que a IA não representa coisa alguma de fundamentalmente novo, quando vista pelo prisma da ciência política.

O processo de cessão de poder a entidades externas não humanas vem ocorrendo há séculos. “Há centenas de anos, estamos construindo versões artificiais de nós mesmos, dotadas de poderes sobre-humanos e projetadas para nos resgatar de nossas limitações demasiadamente humanas”, escreve ele. “O nome dessas estranhas criaturas é estados e corporações”. Assim, ele argumenta que essas duas instituições são as precursoras da inteligência artificial.

Ao descrever o Leviatã, o filósofo inglês Thomas Hobbes foi o primeiro a identificar o Estado como um “Deus mortal” ou um “homem artificial”. Ou, para usar a linguagem moderna da inteligência artificial, o Estado é uma rede neural artificial, sugere Runciman. É melhor compreender os Estados e as corporações como máquinas sociais.

De acordo com Runciman, essas agências não humanas desempenharam papel extraordinário ao ajudar a humanidade a realizar seus objetivos coletivos, julgar entre interesses sociais concorrentes e satisfazer as demandas dos consumidores. Foram essas instituições que possibilitaram a grande aceleração da revolução industrial. Desde então, elas se tornaram repetíveis, mecânicas e adaptáveis. “Uma maneira de resumir o que mudou é que trocamos uma existência arbitrária por uma artificial”, ele escreve.

Mas, como sabemos, os Estados e as corporações também podem ser direcionados a resultados terríveis ou perversos, especialmente quando sua sobrevivência está ameaçada. Considere a intenção assassina dos estados nazista e soviético ou o fato de que 100 empresas são responsáveis por 71% das emissões industriais de gases causadores do efeito estufa geradas no planeta desde 1988.

Runciman argumenta que os Estados e as corporações provocaram a Primeira Singularidade da humanidade, se referindo ao termo teórico usado pelos tecnólogos para descrever uma superinteligência descontrolada e a perda do controle humano.

Portanto, a inteligência artificial poderia ser mais bem descrita como a Segunda Singularidade. No entanto, a distinção fundamental, que Runciman não explora totalmente, é que os Estados e as corporações ainda são animados por atores humanos e não podem exercer agência por conta própria. O medo da Segunda Singularidade, caso ela venha a ocorrer, é que uma inteligência artificial possa assumir tamanha capacidade de ação que torne os seres humanos obsoletos.

Ambos os livros, no entanto, sofrem de um enorme ponto cego, pois a China, uma das duas superpotências tecnológicas do planeta, fica praticamente fora do palco. Está claro que o Partido Comunista chinês tem um modelo de desenvolvimento muito diferente do das democracias ocidentais e pretende manter o Estado, as empresas e a inteligência artificial sob seu controle.

Essa lacuna é abordada em um tomo acadêmico minuciosamente pesquisado por Anu Bradford, em “Digital Empires”, que compara e contrasta os três regimes regulatórios concorrentes nos Estados Unidos, na Europa e na China.

Conforme descreve Bradford, os EUA foram pioneiros em um modelo de desenvolvimento tecnológico amplamente orientado pelo mercado, incentivando o surgimento de empresas dominantes em nível mundial.

Em 2021, a capitalização de mercado combinada da Apple, da Alphabet, da Microsoft e da Meta ultrapassaria o valor das duas mil empresas com ações cotadas na Bolsa de Valores de Tóquio. Mas Bradford, professora da Escola de Direito da Universidade Columbia, não poupa críticas às falhas dessa abordagem e pede leis mais rígidas de privacidade, proteção de dados e antitruste.

Ela também critica o regime regulatório orientado pelo Estado adotado na China. Em sua opinião, a China conseguiu converter a internet de uma ferramenta para o avanço da democracia em uma ferramenta a serviço da autocracia, e tem exportado esse modelo para o exterior.

Pequim agora priorizou o desenvolvimento de tecnologia profunda, como a inteligência artificial, computação quântica e biologia sintética, para estimular o desenvolvimento econômico do país. Mas também usa tecnologia de reconhecimento facial e técnicas de processamento de dados para vigiar seus cidadãos em grande escala, a fim de manter o controle social.

Entre esses regimes excessivamente permissivos e excessivamente opressivos, Bradford, americana de origem finlandesa, argumenta que a União Europeia acertou, em grande parte ao enfatizar uma abordagem orientada por direitos e se tornar a norma global para a privacidade de dados e, em breve, para a regulamentação da inteligência artificial.

Ela rejeita veementemente o argumento de que a regulamentação da União Europeia sufocou a inovação tecnológica. O histórico ruim da Europa na criação de empresas de tecnologia de relevância mundial se deve mais à incompletude do mercado único, à falta de mercados de capital dinâmicos e à falta de ambição, argumenta ela com muito mérito.

A grande esperança de Bradford é que os Estados Unidos e a Europa possam combinar suas duas abordagens para produzir um setor de tecnologia que seja dinâmico e adequadamente regulamentado. Segundo ela, a batalha global pelo futuro será travada entre democracias tecnológicas e autocracias tecnológicas. Essa não é uma batalha que os Estados Unidos ou a União Europeia —ou qualquer democracia liberal— possam se dar ao luxo de perder.